Интересное сегодня

Как экранное время влияет на детей: разбор исследований и со...

Как исследования формируют общественное мнение В эпоху, когда родители ищут ответы в интернете, диск...

Как психопатические черты и социальная предрасположенность и...

Введение Психопатия традиционно связывается с высокоуровневыми когнитивными процессами, однако ее вл...

Влияние интервенций, вызывающих воспоминания с помощью запах...

Введение Расстройства, связанные с употреблением алкоголя (РУА), становятся все более распространен...

Развитие аудиовизуальной временной точности предшествует быс...

Введение Нейропластичность позволяет человеческому мозгу адаптироваться к окружающей среде на протяж...

Мозг матери: нейропластичность и эффективная работа в состоя...

Введение в нейропластичность материнского мозга Переход к материнству связан со значительной структ...

4 признака, что ваш брак можно спасти: советы психологов

4 признака, что ваш брак можно спасти Если вы задаётесь вопросом, стоит ли сохранять ваш брак, веро...

Введение

В повседневном общении люди часто просят других оценить свою уверенность в точности утверждений. Эти суждения помогают слушателям решить, насколько следует корректировать свои представления с учетом мнения собеседника. Учитывая важность уверенности в поведении и коммуникации, психологи давно изучают, как люди оценивают свою уверенность и насколько эти оценки точны.

Large Language Model (LLM) чат-боты

Исследователи давно интересуются системами, способными понимать и генерировать человеческую речь — это направление называется обработкой естественного языка (NLP). Современные NLP-модели, такие как ChatGPT или Gemini, обучаются на огромных массивах текстовых данных и используют сложные алгоритмы машинного обучения, включая нейронные сети. Их называют Large Language Models (LLM), потому что они содержат миллиарды параметров, позволяющих имитировать человеческую речь.

Как работают LLM?

Генеративные ИИ-чаты предсказывают наиболее вероятный ответ на запрос пользователя, но не обладают сознанием или интроспекцией. Они просто вычисляют статистические закономерности в данных.

Метакогнитивные способности LLM

Метакогниция — это способность оценивать собственные когнитивные процессы. Люди используют три типа сигналов для таких оценок:

- Внутренние сигналы (например, сложность задачи)

- Внешние сигналы (например, контекст выполнения)

- Мнемонические сигналы (например, легкость вспоминания)

LLM могут использовать только внутренние и частично внешние сигналы, так как у них нет субъективного опыта.

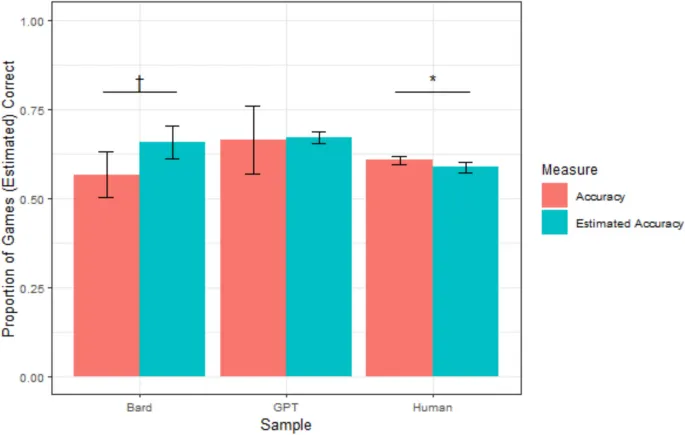

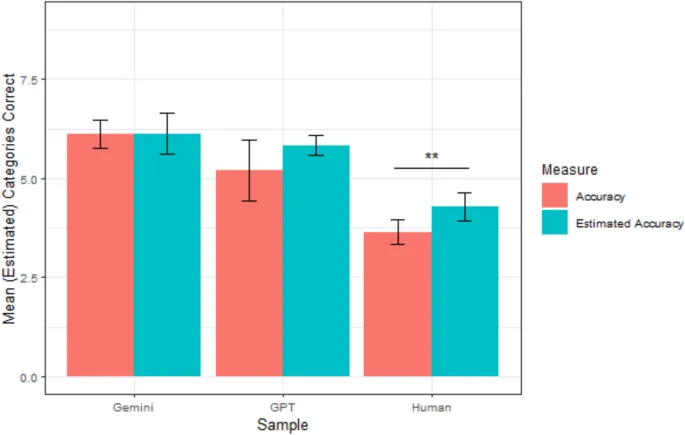

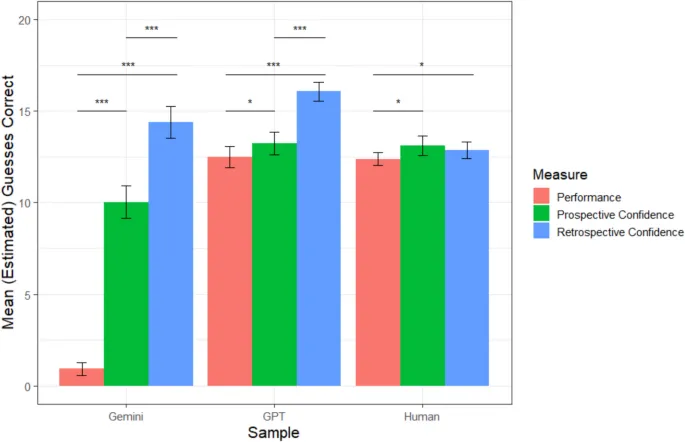

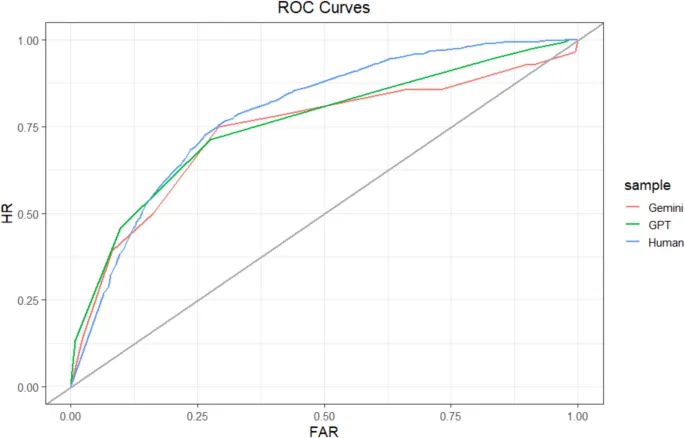

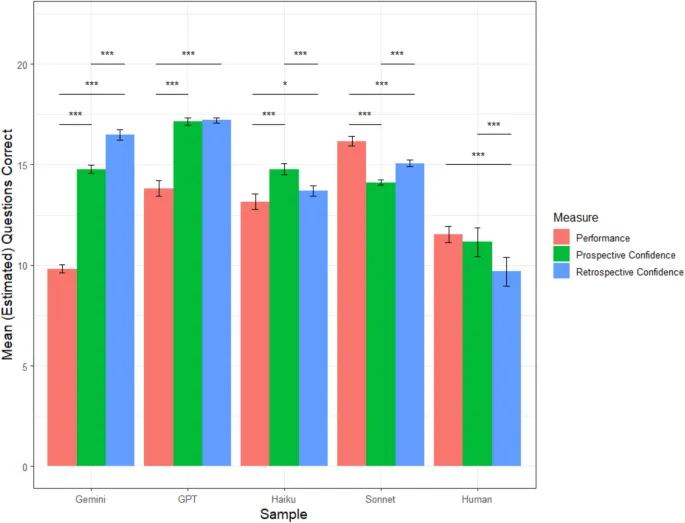

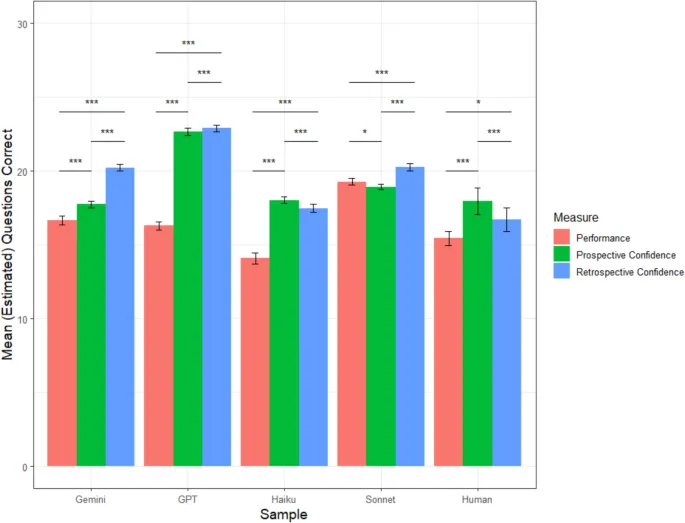

Точность уверенности у LLM и людей

Исследования показывают, что LLM, как и люди, склонны к переоценке своей точности. Однако некоторые модели (например, Claude) демонстрируют лучшую калибровку. В отличие от людей, LLM хуже учатся на собственном опыте и не всегда корректируют уверенность после выполнения задачи.

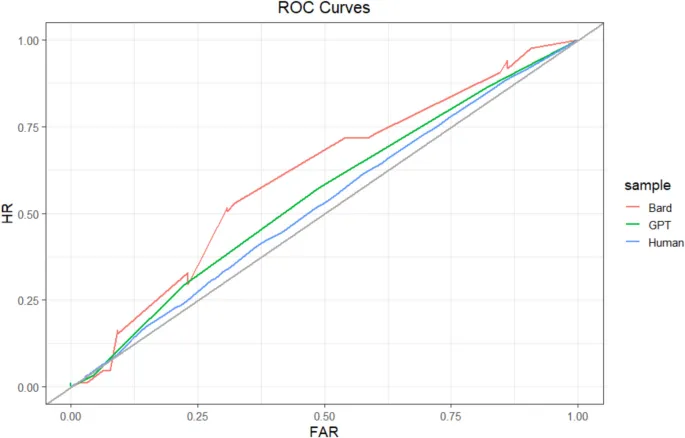

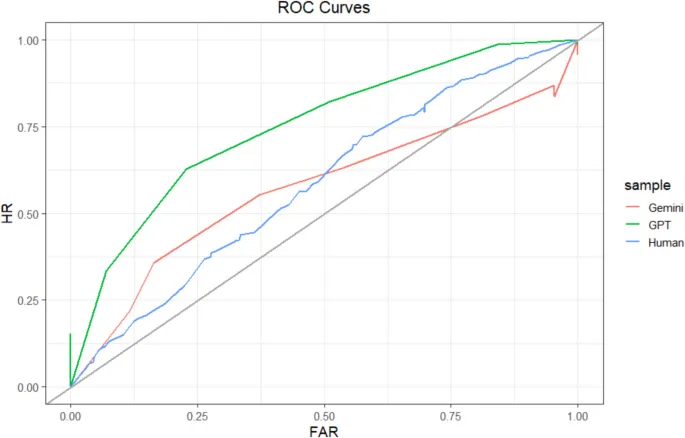

Абсолютная и относительная точность

Абсолютная точность (калибровка) показывает, насколько уверенность совпадает с реальной точностью. Относительная точность (разрешение) отражает способность различать более и менее надежные ответы. В некоторых задачах LLM превосходят людей, в других — уступают.

Выводы

LLM демонстрируют схожую с людьми точность оценки уверенности, но используют иные механизмы. Их суждения зависят от статистических закономерностей, а не интроспекции. Будущие исследования помогут лучше понять, как ИИ формирует уверенность и можно ли ему доверять в критически важных областях.