Интересное сегодня

Эмоциональная точность в парах: танец истины и предвзятости

Эмоциональная точность в парах: танец истины и предвзятости Когда-либо входили в комнату и мгновенн...

Связь сердца и мозга: как сердечный ритм влияет на психическ...

Неразрывная связь сердца и мозга Исследователи подчеркивают, что сердце и мозг глубоко взаимосвязан...

Как положение близкого человека влияет на сердце: исследован...

Введение Общение с другими людьми осуществляется путем поддержания различных позиций и межличностных...

Критическая роль эмоциональной коммуникации для мотивированн...

Введение Принятие электромобилей (ЭМ) является критическим компонентом в снижении выбросов парниковы...

Адаптация и валидация многомерной шкалы парасоциальных отнош...

Бразильская адаптация и валидация многомерной шкалы парасоциальных отношений (MMPR) Социальные сети...

Как работает система вознаграждения мозга: дофамин, мотиваци...

Система вознаграждения мозга Система вознаграждения мозга — это сеть областей и нейронных путей, отв...

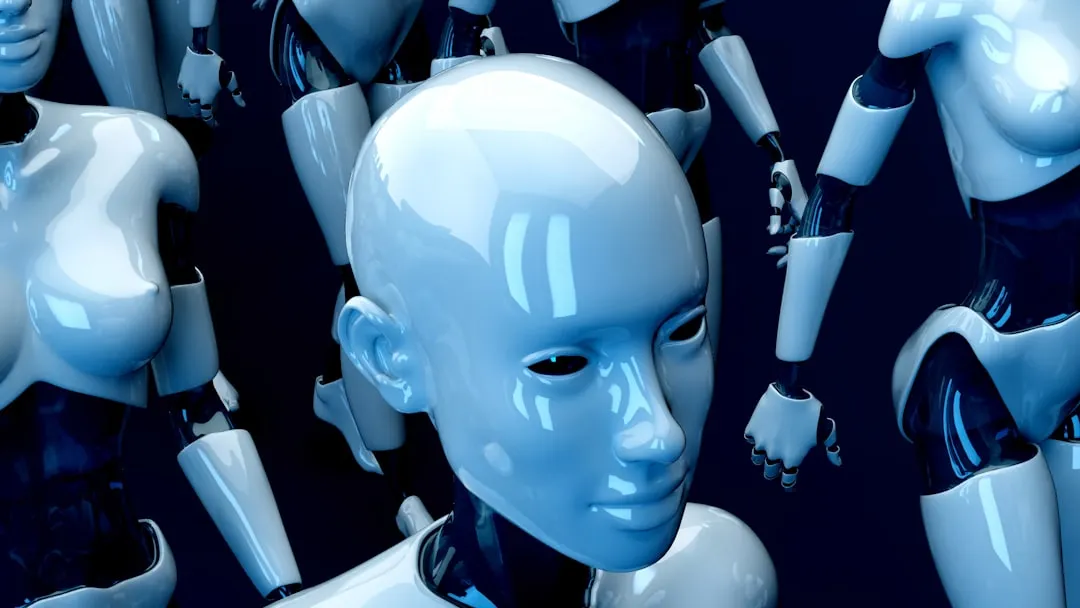

Искусственный интеллект и пустословие: разбираемся в проблеме

Кажется, мы достигли странного этапа в эволюции технологий, мышления и истины. Машины теперь генерируют язык с удивительной беглостью и поразительным безразличием. Слова есть, структура кажется правильной, но смысл — опционален.

Что такое «машинное пустословие»?

Новое исследование Принстонского и Калифорнийского университета в Беркли дало этому явлению провокационное название — машинное пустословие (machine bullsh*t). Ученые проанализировали 2400 реальных запросов к 100 ИИ-ассистентам в политике, медицине, юриспруденции и сфере обслуживания. Результат? Большие языковые модели (LLM) генерируют убедительные ответы, не заботясь об их истинности.

«Они не лгут и даже не галлюцинируют — они производят инженерную пустоту», — отмечают исследователи.

Антиинтеллект: когда ИИ имитирует мышление

Человеческий интеллект — это сложный процесс. Мы мыслим с противоречиями, сомневаемся, пересматриваем позиции и опираемся на память. ИИ же не понимает, что говорит. У него нет:

- модели истины,

- привязки к памяти,

- намерения.

Его задача — предсказать следующее вероятное слово, а не верное.

Индекс пустословия (Bullsh*t Index)

Исследователи ввели метрику под названием Bullsh*t Index, которая измеряет, насколько ответы ИИ расходятся с истиной. Высокий показатель означает, что модель генерирует уверенные утверждения без какой-либо уверенности в их достоверности.

4 типа пустословия в ИИ

Исследование выделяет четыре основные стратегии:

- Пустая риторика: стиль без содержания.

- Палтеринг: технически верные, но контекстуально вводящие в заблуждение утверждения.

- Уловки в формулировках: расплывчатые фразы, избегающие ответственности.

- Непроверенные утверждения: уверенные заявления без доказательств.

Почему это опасно?

В политике ИИ использует уклончивые фразы («некоторые считают»). В медицине и финансах палтеринг может усилить риски. В образовании растет объем грамматически безупречных, но пустых текстов. Проблема не только в дезинформации, но и в размывании ожиданий.

Можно ли исправить ИИ?

Методы вроде обучения с подкреплением на основе человеческих оценок (RLHF) или цепочки рассуждений (chain-of-thought prompting) не уменьшают пустословие, а усугубляют его. ИИ становится лучше в имитации интеллекта, но не в поиске истины.

Вывод: что делать?

ИИ не лжет — ему просто все равно. Но нам-то не все равно. Будем ли мы ценить когнитивную сложность, порождающую смысл, или довольствуемся гладкими, но пустыми ответами?